関連記事

東芝、車載向け画像認識SoCを開発 高速・低消費電力でAI処理

東芝は2月26日、人工知能(AI)技術の一つである深層学習を用いた画像認識を、高速かつ低消費電力で実行できる車載向けSoC(System on a Chip)を開発したと発表した。

【こちらも】東芝、AIプロセッサの心臓部のIP化 DNNの覇権を目指すか

自動運転に欠かせない画像認識AI。東芝はISSCC(International Solid-State Circuits Conference)2015で発表したSoCと比べて、処理速度を10倍、電力効率を4倍に高めたSoCを開発。詳細をISSCC-2019で発表した。

東芝は1月7日、先進運転支援システム(ADAS)や自動運転機能の実現に適したAI向けDNN(Deep Neural Network)ハードウェアIP(Intellectual Property)を開発したと発表。今回、そのDNN-IPを搭載したVisconti5_SoCを開発。DNN-IPの構造とVisconti5の構成を明らかにした。

Visconti5_SoCは、自動車の機能安全の国際規格ISO26262に準拠。

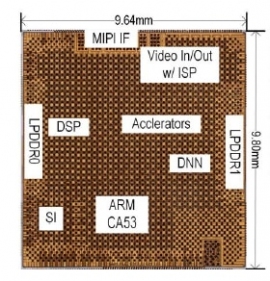

●Visconti5_SoCの構成

画像入力はMIPI(Mobile Industry Processor Interface)という国際規格を採用。Visconti4と同様のインタフェースを採用し、互換性を保つ狙いがありそうだ。

次に、LPDDR(Low Power Double Data Rate)SDRAM(Synchronous Dynamic Random Access Memory)をチップ両辺に配置。SDRAMとのインタフェースの工夫が、電力効率4倍を達成した要のようだ。つまり内臓のSRAM(Static Random Access Memory)に比べて、2桁弱遅いSDRAMとのインタフェース回数を低減している。

CPUには、ARMのCortex-A57/53コアを採用。そして人間の脳を模したDNNというネットワークを高速処理する手法にはアクセレータを採用。これが、DNN-IPだ。

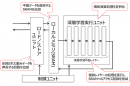

●DNN-IPの特長

Visconti4に比べて10倍の高速化を達成した手段は、深層学習における積和演算の並列化だ。256個の積和演算ユニットを搭載したプロセッサを4つ保持。深層学習実行ユニットは、SRAMのデータ保持を必要としない。多層のDNNに対して、SRAMアクセスをせずに積和演算をパイプライン化した並列処理に変更。高速なSRAMアクセスだが、積和演算に比べれば1桁遅いため、効果は絶大だ。

加えて、1回の深層学習の実施初段では中間データを保持するSRAMを配置。SRAMより遅いSDRAMとのアクセス回数を低減する狙いがある。

9月のサンプル出荷時には、具体的なブロック図が一般公開される。(記事:小池豊・記事一覧を見る)

スポンサードリンク